알리바바가 영상 생성 및 편집을 위한 최신 오픈소스 AI 모델 ‘Wan2.1-VACE(Video All-in-one Creation and Editing)’를 공식 발표했다.

이번 모델은 다양한 영상 처리 기능을 하나로 통합해 영상 제작 과정을 간소화하고, 크리에이터의 효율성과 생산성을 극대화하는 데 중점을 두었다. Wan2.1-VACE는 알리바바의 영상 생성 특화 대규모 모델 시리즈인 ‘Wan2.1’에 속하며, 영상 생성 및 편집 기능을 아우르는 업계 최초의 오픈소스 통합 모델이다.

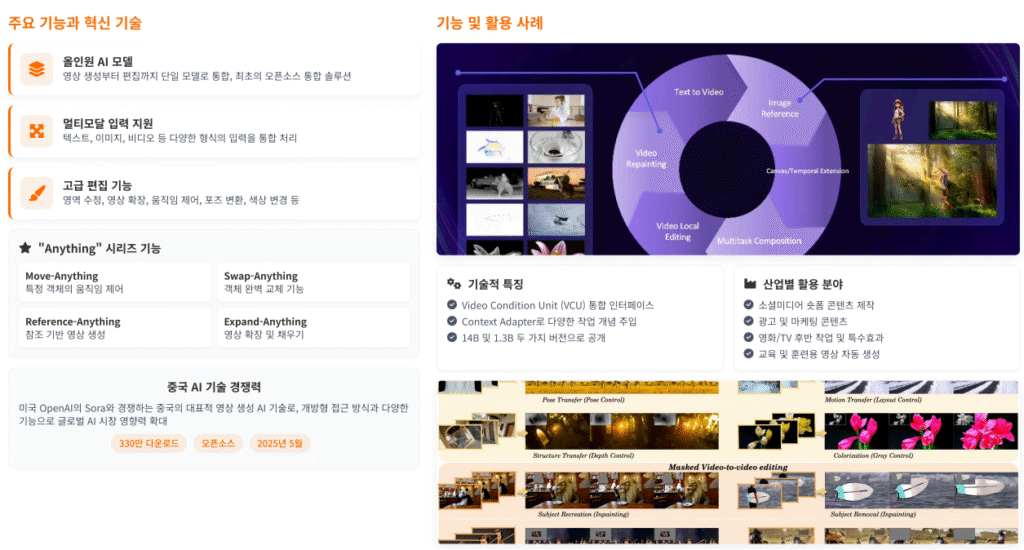

해당 모델은 텍스트, 이미지, 영상 등 다양한 멀티모달 입력을 기반으로 영상 생성이 가능하며, 이미지나 특정 프레임을 참조해 편집하거나, 영상 내 선택 영역을 수정·재구성하고, 시공간 확장까지 지원하는 고급 편집 기능을 제공한다. 이를 통해 사용자는 여러 작업을 유연하게 결합해 더욱 창의적인 결과물을 만들 수 있다.

Wan2.1-VACE는 이미지 샘플을 바탕으로 상호작용하는 객체가 포함된 영상을 생성하거나, 정적인 이미지를 자연스럽게 움직이게 하여 생동감을 부여할 수 있다. 포즈 전환, 움직임 제어, 깊이 조절, 색상 재처리 등의 기능도 포함돼 고도화된 영상 리페인팅을 지원한다.

또한, 영상 내 특정 영역을 주변에 영향을 주지 않고 수정하거나 삭제·추가할 수 있으며, 영상 경계를 확장하고 자동으로 자연스러운 콘텐츠를 생성해 시각적 풍부함을 더한다.

사용자는 정적인 이미지를 영상으로 변환하는 동시에 객체의 이동 경로를 지정해 움직임을 제어하거나, 특정 인물·사물을 참조해 치환 및 애니메이션 처리도 가능하다. 수직 이미지를 가로 영상으로 확장하면서 새로운 요소를 추가하는 작업 역시 손쉽게 수행할 수 있다.

Wan2.1-VACE는 다양한 영상 편집 작업의 니즈를 고려한 첨단 기술을 다수 적용했다. 멀티모달 입력(텍스트, 이미지, 영상, 마스크 등)을 일괄 처리하는 통합 인터페이스 ‘VCU(Video Condition Unit)’를 도입했으며, 시간적·공간적 요소를 정형화된 방식으로 표현하는 ‘컨텍스트 어댑터(Context Adapter)’ 구조를 통해 각 작업 개념을 효율적으로 모델에 주입할 수 있도록 설계되었다.

이를 기반으로 폭넓은 영상 합성 작업을 유연하게 관리할 수 있다. 특히 이 같은 구조적 혁신 덕분에 Wan2.1-VACE는 SNS 숏폼 영상의 빠른 제작, 광고·마케팅용 콘텐츠 창작, 영상 후반 작업 및 특수효과 적용, 교육용 트레이닝 콘텐츠 제작 등 다양한 분야에서 폭넓게 활용될 수 있다.

영상 기반 AI 모델을 훈련하려면 막대한 연산 자원과 고품질 학습 데이터가 필요하다. Wan2.1-VACE는 오픈소스를 통해 이러한 장벽을 낮추고, 더 많은 기업이 빠르고 경제적인 방식으로 자사 니즈에 맞춘 고품질 영상 콘텐츠를 제작할 수 있도록 지원한다.

Wan2.1-VACE는 파라미터 수 기준으로 140억(14B) 버전과 13억(1.3B) 버전 두 가지 형태로 제공된다. 현재 해당 모델은 허깅페이스(Hugging Face), 깃허브(GitHub), 알리바바 클라우드 오픈소스 커뮤니티 모델스코프(ModelScope)에서 누구나 무료로 다운로드할 수 있다.

알리바바는 자사 개발 대규모 AI 모델을 가장 먼저 오픈소스로 공개한 글로벌 주요 기술 기업 중 하나로, 지난 2월에는 Wan2.1 시리즈의 4가지 모델을, 지난달에는 시작 및 종료 프레임 기반 영상 생성 모델을 각각 공개한 바 있다. 현재까지 해당 모델들은 허깅페이스와 모델스코프에서 총 330만 건 이상의 누적 다운로드를 기록하며 높은 관심을 받고 있다.

Leave a Comment